במסמך הזה מפורט סיכום של הגישה לפרטיות בפרסונליזציה במכשיר (ODP), במיוחד בהקשר של פרטיות דיפרנציאלית. כדי לשמור על המיקוד של המסמך הזה, בכוונה לא כללנו בו השלכות אחרות על הפרטיות והחלטות עיצוב כמו צמצום הנתונים.

פרטיות דיפרנציאלית

פרטיות דיפרנציאלית 1 היא תקן נפוץ להגנה על פרטיות בניתוח נתונים סטטיסטיים ובלמידת מכונה 2 3. באופן לא רשמי, אפשר לומר שהיא קובעת שהיריב לומד כמעט את אותו הדבר על משתמש מהפלט של אלגוריתם פרטיות דיפרנציאלית, בין אם הרשומה שלו מופיעה במערך הנתונים הבסיסי ובין אם לא. המשמעות היא הגנה חזקה על אנשים פרטיים: כל מסקנה שמוסקים לגבי אדם מסוים יכולה לנבוע רק ממאפיינים מצטברים של מערך הנתונים, שיהיו תקפים גם אם הרשומה של אותו אדם לא תכלל במערך.

בהקשר של למידת מכונה, הפלט של האלגוריתם צריך להיות הפרמטרים של המודל המאומן. הביטוי כמעט אותו דבר מוגדר מבחינה מתמטית על ידי שני פרמטרים (ε, δ), כאשר ε נבחר בדרך כלל להיות קבוע קטן, ו-δ≪1/(מספר המשתמשים).

סמנטיקה של פרטיות

העיצוב של ODP נועד להבטיח שכל הרצת אימון תהיה פרטית דיפרנציאלית ברמת המשתמש (ε,δ). בהמשך מפורטת הגישה שלנו להשגת המשמעות הסמנטית הזו.

מודל איומים

אנחנו מגדירים את הצדדים השונים ומציינים הנחות לגבי כל אחד מהם:

- משתמש: המשתמש שהוא הבעלים של המכשיר, ושהוא צרכן של מוצרים או שירותים שמסופקים על ידי המפתח. המידע הפרטי שלהם זמין להם באופן מלא.

- סביבת מחשוב אמינה (TEE): נתונים וחישובים מהימנים שמתבצעים בתוך סביבות TEE מוגנים מפני תוקפים באמצעות מגוון טכנולוגיות. לכן, אין צורך בהגנה נוספת על החישוב והנתונים. יכול להיות שסביבות TEE קיימות מאפשרות לאדמינים של הפרויקט לגשת למידע שבתוכן. אנחנו מציעים יכולות מותאמות אישית כדי למנוע גישה של אדמין ולבדוק שהגישה לא זמינה.

- התוקף: יכול להיות שיש לו מידע נוסף על המשתמש ויש לו גישה מלאה לכל מידע שיוצא מ-TEE (למשל, פרמטרים של מודל שפורסם).

- מפתח: מי שמגדיר ומאמן את המודל. נחשב ללא מהימן (ויש לו את כל היכולות של תוקף).

אנחנו שואפים לעצב את ODP עם הסמנטיקה הבאה של פרטיות דיפרנציאלית:

- גבול האמון: מנקודת המבט של משתמש מסוים, גבול האמון מורכב מהמכשיר של המשתמש ומה-TEE. כל מידע שיוצא מגבולות האמון האלה צריך להיות מוגן על ידי פרטיות דיפרנציאלית.

- התוקף: הגנה מלאה על הפרטיות הדיפרנציאלית מפני התוקף. כל ישות מחוץ לגבולות האמון יכולה להיות תוקף (כולל המפתח ומשתמשים אחרים, שכולם עלולים לשתף פעולה). התוקף, בהינתן כל המידע מחוץ לגבולות האמון (לדוגמה, המודל שפורסם), כל מידע צדדי על המשתמש ומשאבים בלתי מוגבלים, לא יכול להסיק נתונים פרטיים נוספים על המשתמש (מעבר לנתונים שכבר נמצאים במידע הצדדי), עד לסיכויים שנקבעו בתקציב הפרטיות. בפרט, המשמעות היא הגנה מלאה על הפרטיות הדיפרנציאלית ביחס למפתח. כל מידע שמועבר למפתח (כמו פרמטרים של מודל מאומן או מסקנות מצטברות) מוגן באמצעות פרטיות דיפרנציאלית.

פרמטרים של מודל מקומי

הסמנטיקה הקודמת של הפרטיות מתאימה למקרה שבו חלק מפרמטרים של המודל הם לוקליים למכשיר (לדוגמה, מודל שמכיל הטמעה של משתמש שספציפית לכל משתמש, ולא משותפת בין משתמשים). במודלים כאלה, הפרמטרים המקומיים האלה נשארים בתוך גבולות האמון (הם לא מתפרסמים) ולא נדרשת הגנה עליהם, בעוד שפרמטרים של מודלים משותפים מתפרסמים (ומוגנים על ידי פרטיות דיפרנציאלית). המודל הזה נקרא לפעמים מודל הפרטיות של לוח המודעות 4.

תכונות ציבוריות

בחלק מהאפליקציות, חלק מהתכונות הן ציבוריות. לדוגמה, בבעיה של המלצה על סרט, המאפיינים של הסרט (הבמאי, הז'אנר או שנת היציאה של הסרט) הם מידע ציבורי שלא דורש הגנה, בעוד שהמאפיינים שקשורים למשתמש (כמו מידע דמוגרפי או הסרטים שהמשתמש צפה בהם) הם נתונים פרטיים שדורשים הגנה.

המידע הציבורי מפורמל כמטריצת תכונות ציבורית (בדוגמה הקודמת, המטריצה הזו תכיל שורה אחת לכל סרט ועמודה אחת לכל תכונה של הסרט), שזמינה לכל הצדדים. אלגוריתם האימון עם פרטיות דיפרנציאלית יכול להשתמש במטריצה הזו בלי צורך להגן עליה. דוגמה לכך מופיעה במאמר 5. הפלטפורמה ODP מתכננת להטמיע אלגוריתמים כאלה.

גישה לפרטיות במהלך חיזוי או הסקה

ההסקות מבוססות על פרמטרים של המודל ועל תכונות קלט. הפרמטרים של המודל מאומנים באמצעות סמנטיקה של פרטיות דיפרנציאלית. במאמר הזה נסביר על התפקיד של תכונות הקלט.

במקרים מסוימים, אם למפתח כבר יש גישה מלאה לתכונות שמשמשות להסקת מסקנות, אין חשש לפרטיות כתוצאה מהסקת המסקנות, והמפתח יכול לראות את התוצאה של הסקת המסקנות.

במקרים אחרים (כשהתכונות שמשמשות להסקת מסקנות הן פרטיות ולא נגישות למפתח), יכול להיות שתוצאת ההסקה תוסתר מהמפתח. למשל, אם ההסקה (וכל תהליך במורד הזרם שמשתמש בתוצאת ההסקה) יופעל במכשיר, בתהליך ובאזור תצוגה שבבעלות מערכת ההפעלה, עם תקשורת מוגבלת מחוץ לתהליך הזה.

תהליך האימון

סקירה כללית

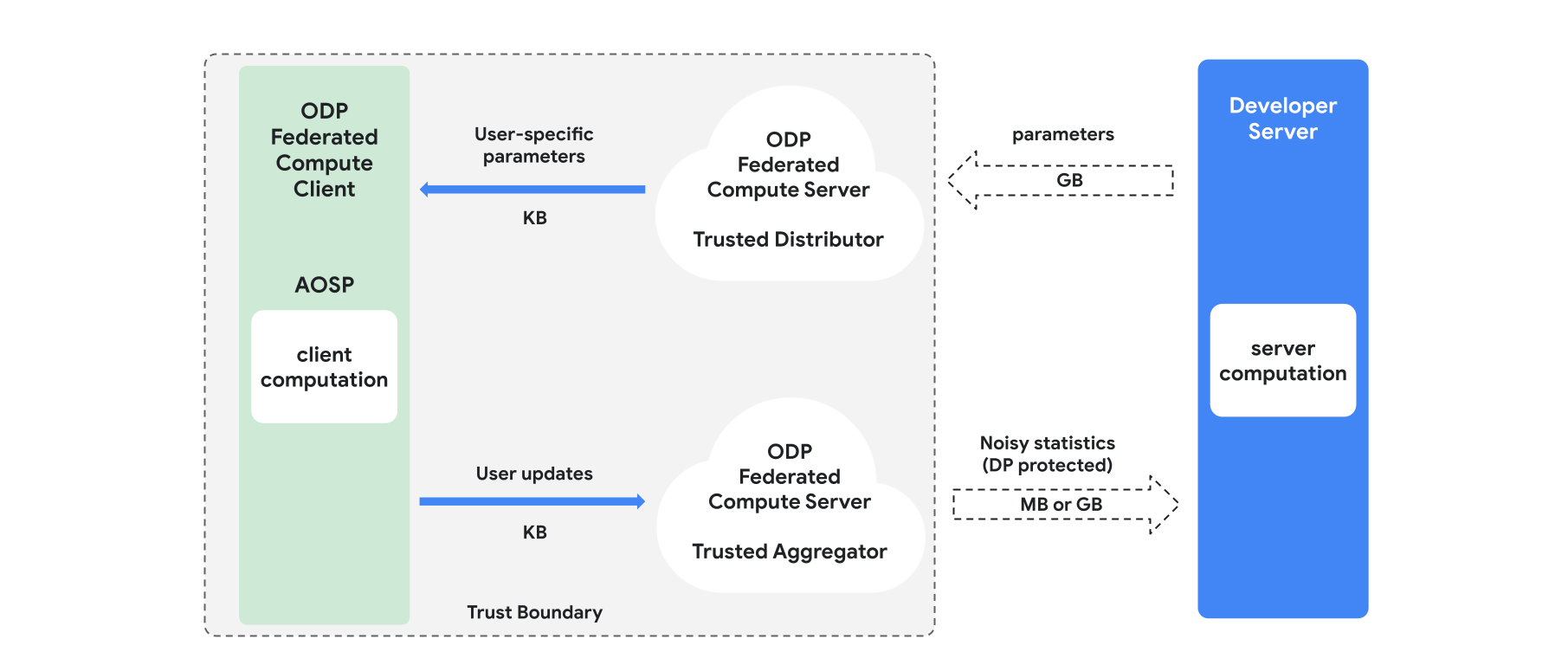

בקטע הזה מופיעה סקירה כללית של הארכיטקטורה ושל תהליך האימון (ראו איור 1). ODP כולל את הרכיבים הבאים:

מפיץ מהימן, כמו Federated Select, Trusted Download או Private Information Retrieval, שממלא תפקיד של פרמטרים של מודל שידור. ההנחה היא שהמפיץ המהימן יכול לשלוח קבוצת משנה של פרמטרים לכל לקוח, בלי לחשוף אילו פרמטרים הורדו על ידי איזה לקוח. השידור החלקי הזה מאפשר למערכת לצמצם את טביעת הרגל במכשיר של משתמש הקצה: במקום לשלוח עותק מלא של המודל, רק חלק קטן מפרמטרים של המודל נשלח לכל משתמש.

אגרגטור מהימן, שמצליב מידע מכמה לקוחות (למשל, שיפועים או נתונים סטטיסטיים אחרים), מוסיף רעש ושולח את התוצאה לשרת. ההנחה היא שיש ערוצים מהימנים בין הלקוח לבין המצטבר, ובין הלקוח לבין המפיץ.

אלגוריתמים לאימון DP שפועלים בתשתית הזו. כל אלגוריתם אימון מורכב מחישובים שונים שפועלים ברכיבים השונים (שרת, לקוח, צובר, מפיץ).

סבב אימון טיפוסי כולל את השלבים הבאים:

- השרת משדר את פרמטרים של המודל למפיץ מהימן.

- חישוב בצד הלקוח

- כל מכשיר לקוח מקבל את המודל המשודר (או את קבוצת המשנה של הפרמטרים שרלוונטיים למשתמש).

- כל לקוח מבצע חישוב מסוים (לדוגמה, חישוב של שיפועים או נתונים סטטיסטיים מספיקים אחרים).

- כל לקוח שולח את תוצאת החישוב למצטבר המהימן.

- הצד המצטבר המהימן אוסף את הנתונים הסטטיסטיים מהלקוחות, מצטבר אותם ומגן עליהם באמצעות מנגנונים מתאימים של פרטיות דיפרנציאלית, ואז שולח את התוצאה לשרת.

- חישוב בשרת

- השרת (לא מהימן) מריץ חישובים על נתונים סטטיסטיים שמוגנים על ידי פרטיות דיפרנציאלית (לדוגמה, הוא משתמש בגרדיאנטים מצטברים של פרטיות דיפרנציאלית כדי לעדכן את פרמטרים של המודל).

מודלים עם פירוק לגורמים ומיזעור לסירוגין עם פרטיות דיפרנציאלית

פלטפורמת ה-ODP מתכננת לספק אלגוריתמים כלליים לאימון פרטיות דיפרנציאלית שאפשר להחיל על כל ארכיטקטורת מודל (כמו DP-SGD 6 7 8 או DP-FTRL 9 10), וגם אלגוריתמים שמתמחים במודלים מפורקים.

מודלים עם פירוק לגורמים הם מודלים שאפשר לפרק למודלים משניים (שנקראים מקודדים או מגדלים). לדוגמה, נניח שיש מודל מהצורה f(u(θu, xu), v(θv, xv)), שבו u() מקודד את מאפייני המשתמש xu (ויש לו פרמטרים θu), ו-v() מקודד את המאפיינים שאינם קשורים למשתמש xv (ויש לו פרמטרים θv). שני הקידודים משולבים באמצעות f() כדי ליצור את התחזית הסופית של המודל. לדוגמה, במודל להמלצות על סרטים, xu הם מאפייני המשתמש וxv הם מאפייני הסרט.

מודלים כאלה מתאימים מאוד לארכיטקטורת המערכת המבוזרת שצוינה למעלה (כי הם מפרידים בין התכונות למשתמשים לבין התכונות שלא מיועדות למשתמשים).

מודלים עם פירוק לגורמים יאומנו באמצעות שיטה של מינימיזציה מתחלפת עם פרטיות דיפרנציאלית (DPAM), שבה מתבצעת אופטימיזציה של הפרמטרים θu (בזמן ש-θv קבוע) ולהפך. הוכח שאלגוריתמים של DPAM משיגים שימושיות טובה יותר במגוון הגדרות 4 11, במיוחד בנוכחות תכונות ציבוריות.

קובצי עזר

- 1: Dwork et al. Calibrating Noise to Sensitivity in Private Data Analysis, TCC'06

- 2: US Census Bureau. הסבר על פרטיות דיפרנציאלית, 2020

- 3: Federated Learning with Formal Differential Privacy Guarantees, Google AI Blog Post, 2020

- 4: Jain et al. Differentially Private Model Personalization, NeurIPS'21

- 5: Krichene et al. Private Learning with Public Features, 2023

- 6: Song et al. Stochastic gradient descent with differentially private updates, GlobalSIP'13

- 7: Differentially Private Empirical Risk Minimization: Efficient Algorithms and Tight Error Bounds, FOCS'14

- 8: Abadi et al. Deep Learning with Differential Privacy, CCS '16

- 9: Smith et al. (Nearly) Optimal Algorithms for Private Online Learning in Full-information and Bandit Settings, NeurIPS'13

- 10: Kairouz et al., Practical and Private (Deep) Learning without Sampling or Shuffling, ICML'21

- 11: Chien et al. Private Alternating Least Squares, ICML'21