1. Prasyarat

Untuk melakukan Codelab ini, beberapa prasyarat diperlukan. Setiap persyaratan ditandai sesuai dengan apakah persyaratan tersebut diperlukan untuk "Pengujian Lokal" atau "Layanan Agregasi".

1.1. Mendownload Alat Pengujian Lokal (Pengujian Lokal)

Pengujian Lokal akan memerlukan download Alat Pengujian Lokal. Alat ini akan membuat laporan ringkasan dari laporan debug yang tidak dienkripsi.

Alat Pengujian Lokal tersedia untuk didownload di Arsip JAR Lambda di GitHub. File tersebut harus diberi nama LocalTestingTool_{version}.jar.

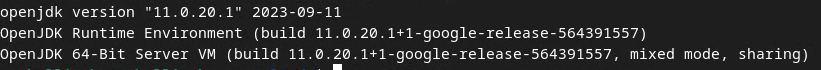

1.2. Verifikasi bahwa JAVA JRE telah diinstal (Layanan Pengujian Lokal dan Penggabungan)

Buka "Terminal" dan gunakan java --version untuk memeriksa apakah mesin Anda telah menginstal Java atau openJDK.

Memeriksa versi JRE Java menggunakan `java --version`.

Memeriksa versi JRE Java menggunakan `java --version`.

Jika belum diinstal, Anda dapat mendownload dan menginstalnya dari situs Java atau situs openJDK.

1.3. Mendownload Pengonversi Laporan yang Dapat Digabungkan (Pengujian Lokal dan Layanan Agregasi)

Anda dapat mendownload salinan konverter laporan yang dapat digabungkan dari repositori GitHub Demo Privacy Sandbox.

1.4. Mengaktifkan Ad Privacy API (Pengujian Lokal dan Layanan Agregasi)

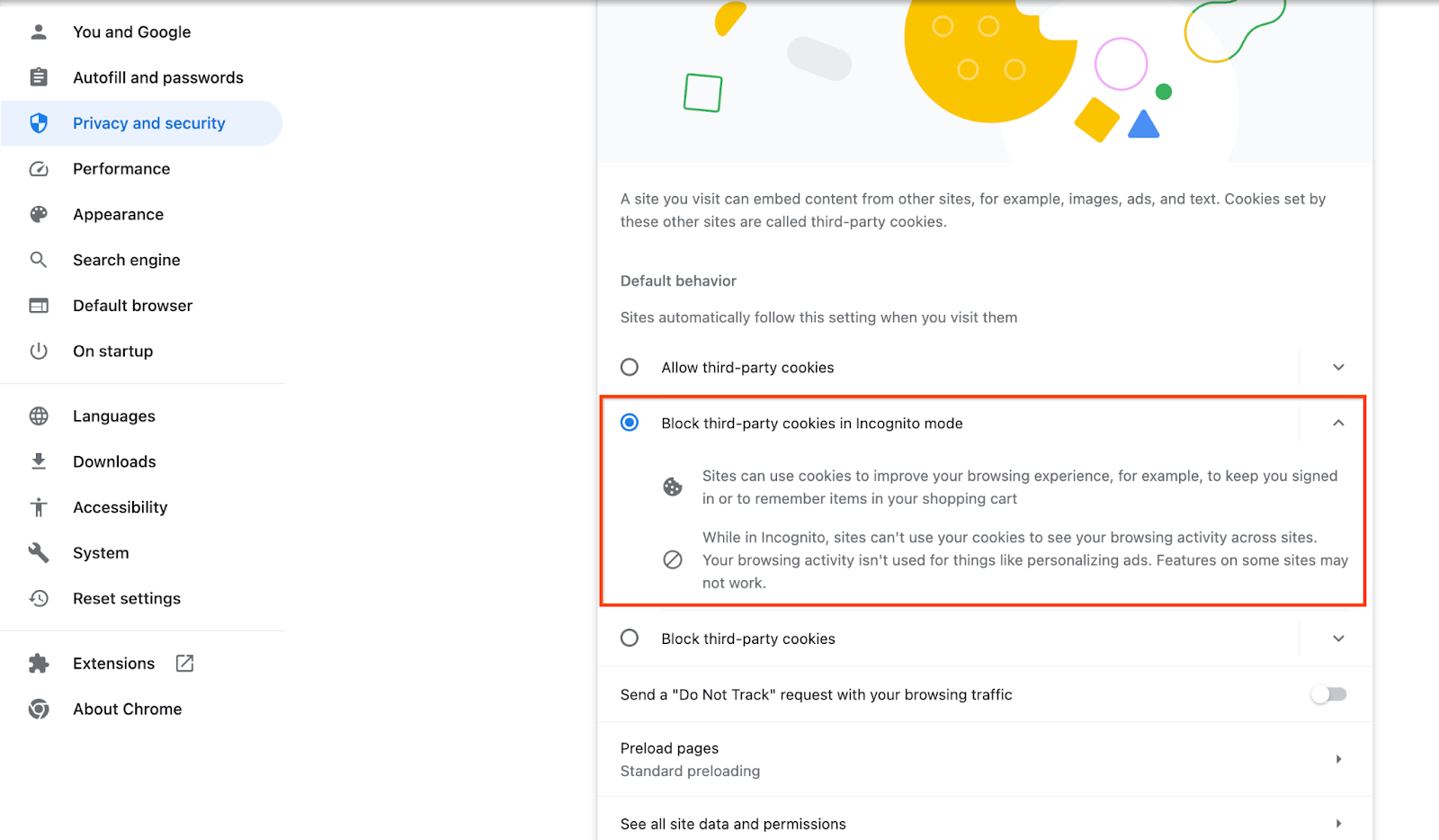

Di browser Anda, buka chrome://settings/adPrivacy dan aktifkan semua Ad Privacy API.

Pastikan cookie pihak ketiga diaktifkan.

Di browser Anda, buka chrome://settings/cookies, lalu pilih "Blokir cookie pihak ketiga dalam mode Samaran".

Setelan chrome cookie pihak ketiga.

Setelan chrome cookie pihak ketiga.

1.5. Pendaftaran web dan Android (Layanan Agregasi)

Untuk menggunakan API Privacy Sandbox di lingkungan produksi, pastikan Anda telah menyelesaikan pendaftaran dan pengesahan untuk Chrome dan Android.

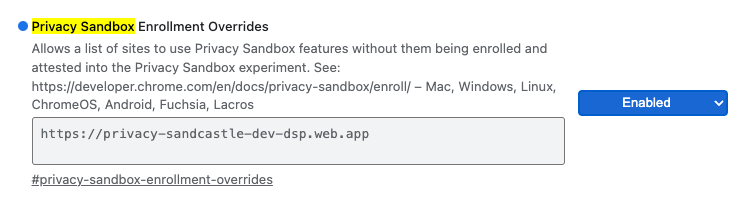

Untuk pengujian lokal, pendaftaran dapat dinonaktifkan menggunakan tombol CLI dan tanda chrome.

Untuk menggunakan tombol Chrome untuk demo kami, buka chrome://flags/#privacy-sandbox-enrollment-overrides dan perbarui penggantian dengan situs Anda atau jika Anda akan menggunakan situs demo kami, tidak ada pembaruan yang diperlukan.

Tombol penggantian pendaftaran Privacy Sandbox di Chrome.

Tombol penggantian pendaftaran Privacy Sandbox di Chrome.

1.6. Pengaktifan Layanan Agregasi (Layanan Agregasi)

Layanan Agregasi memerlukan aktivasi ke koordinator agar dapat menggunakan layanan. Selesaikan formulir Pengaktifan Layanan Agregasi dengan memberikan alamat situs pelaporan, ID Akun AWS, dan informasi lainnya.

1.7. Penyedia cloud (Layanan Penggabungan)

Layanan Agregasi memerlukan penggunaan Trusted Execution Environment yang menggunakan lingkungan cloud. Layanan agregasi didukung di Amazon Web Services (AWS) dan Google Cloud (GCP). Codelab ini hanya akan membahas integrasi AWS.

AWS menyediakan Trusted Execution Environment yang disebut Nitro Enclaves. Pastikan Anda memiliki akun AWS dan ikuti petunjuk penginstalan dan update AWS CLI untuk menyiapkan lingkungan AWS CLI Anda.

Jika AWS CLI Anda baru, Anda dapat mengonfigurasi AWS CLI menggunakan petunjuk Konfigurasi CLI.

1.7.1. Buat bucket AWS S3

Buat Bucket AWS S3 untuk menyimpan status Terraform, dan bucket S3 lain untuk menyimpan laporan dan laporan ringkasan Anda. Anda dapat menggunakan perintah CLI yang diberikan. Ganti kolom di <> dengan variabel yang tepat.

aws s3api create-bucket --bucket <tf_bucket_name> --region us-east-1

aws s3api create-bucket --bucket <report_bucket_name> --region us-east-1

1.7.2. Membuat kunci akses pengguna

Buat kunci akses pengguna menggunakan panduan AWS. URL ini akan digunakan untuk memanggil endpoint API createJob dan getJob yang dibuat di AWS.

1.7.3. Izin pengguna dan grup AWS

Untuk men-deploy Layanan Agregasi di AWS, Anda harus memberikan izin tertentu kepada pengguna yang digunakan untuk men-deploy layanan. Untuk Codelab ini, pastikan pengguna memiliki Akses Administrator untuk memastikan izin penuh dalam deployment.

1.8. Terraform (Layanan Agregasi)

Codelab ini menggunakan Terraform untuk men-deploy Layanan Agregasi. Pastikan biner Terraform diinstal ke lingkungan lokal Anda.

Download biner Terraform ke lingkungan lokal Anda.

Setelah biner Terraform didownload, ekstrak file dan pindahkan biner Terraform ke /usr/local/bin.

cp <directory>/terraform /usr/local/bin

Periksa untuk memastikan Terraform tersedia di classpath.

terraform -v

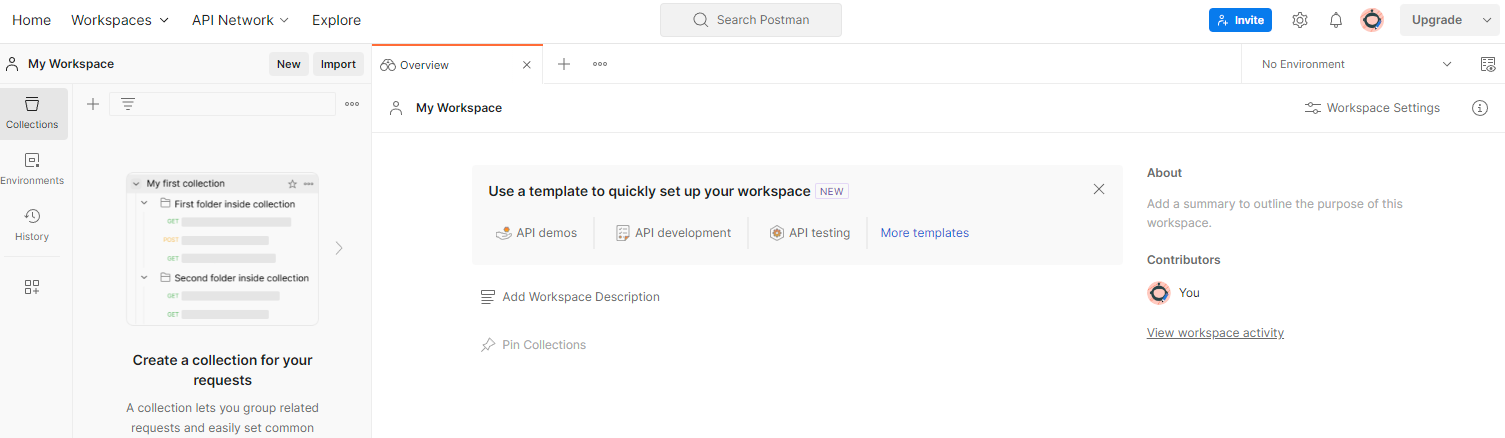

1.9. Postman (Untuk AWS Aggregation Service)

Untuk Codelab ini, gunakan Postman untuk pengelolaan permintaan.

Buat ruang kerja dengan membuka item navigasi atas "Ruang kerja", lalu pilih "Buat Ruang Kerja".

Ruang kerja Postman

Ruang kerja Postman

Pilih "Ruang kerja kosong", klik berikutnya, lalu beri nama "Privacy Sandbox". Pilih "Pribadi", lalu klik "Buat".

Download file konfigurasi JSON ruang kerja yang telah dikonfigurasi sebelumnya dan file Global Environment.

Impor file JSON ke "Ruang Kerja Saya" menggunakan tombol "Impor".

Mengimpor file JSON Postman.

Mengimpor file JSON Postman.

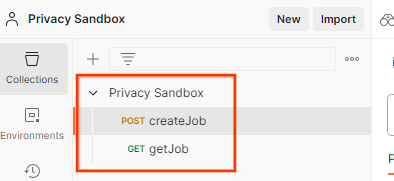

Tindakan ini akan membuat koleksi Privacy Sandbox untuk Anda beserta permintaan HTTP createJob dan getJob.

Kumpulan Postman yang diimpor.

Kumpulan Postman yang diimpor.

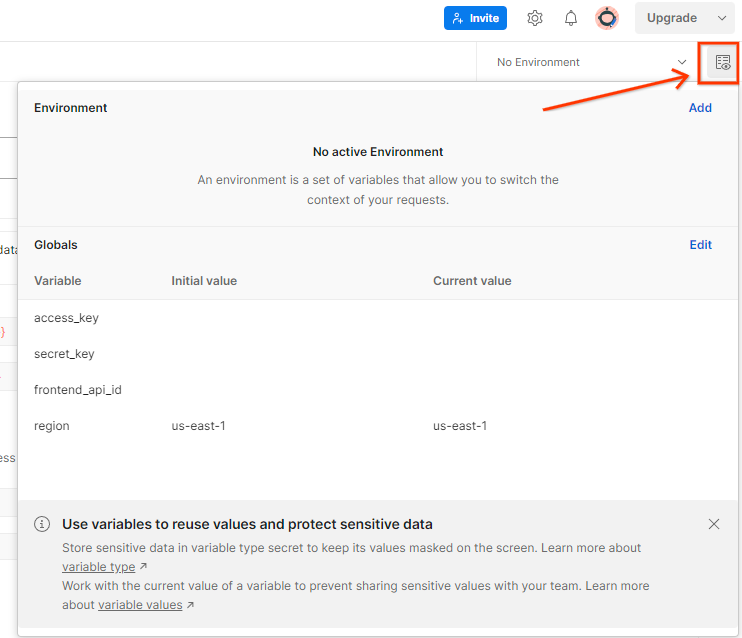

Perbarui "Access Key" dan "Secret Key" AWS melalui "Environment quick look".

Sekilas tentang lingkungan Postman.

Sekilas tentang lingkungan Postman.

Klik "Edit" dan perbarui "Nilai Saat Ini" untuk "access_key" dan "secret_key". Perhatikan bahwa frontend_api_id akan diberikan di bagian 3.1.4 dalam dokumen ini. Sebaiknya gunakan region us-east-1. Namun, jika Anda ingin men-deploy di region lain, pastikan Anda menyalin AMI yang dirilis ke akun Anda atau melakukan build sendiri menggunakan skrip yang disediakan.

Variabel global Postman.

Variabel global Postman.  Mengedit variabel global Postman.

Mengedit variabel global Postman.

2. Codelab Pengujian Lokal

Anda dapat menggunakan alat pengujian lokal di komputer untuk melakukan agregasi dan membuat laporan ringkasan menggunakan laporan debug yang tidak dienkripsi.

Langkah-Langkah Codelab

Langkah 2.1. Laporan pemicu: Memicu pelaporan Private Aggregation agar dapat mengumpulkan laporan.

Langkah 2.2. Buat laporan yang dapat diagregasi untuk proses debug: Konversi laporan JSON yang dikumpulkan menjadi laporan berformat AVRO.

Langkah ini akan serupa dengan saat teknologi iklan mengumpulkan laporan dari endpoint pelaporan API dan mengonversi laporan JSON menjadi laporan berformat AVRO.

Langkah 2.3. Mengurai kunci bucket dari laporan debug: Kunci bucket dirancang oleh teknologi iklan. Dalam codelab ini, karena bucket telah ditentukan sebelumnya, ambil kunci bucket seperti yang diberikan.

Langkah 2.4. Buat AVRO domain output: Setelah kunci bucket diambil, buat file AVRO Domain Output.

Langkah 2.5. Membuat laporan ringkasan menggunakan Alat Pengujian Lokal: Gunakan Alat Pengujian Lokal untuk dapat membuat Laporan Ringkasan di Lingkungan Lokal.

Langkah 2.6. Tinjau laporan ringkasan: Tinjau Laporan Ringkasan yang dibuat oleh Alat Pengujian Lokal.

2.1. Laporan pemicu

Buka situs demo privacy sandbox. Tindakan ini akan memicu laporan agregasi pribadi. Anda dapat melihat laporan di chrome://private-aggregation-internals.

Internal agregasi pribadi Chrome.

Internal agregasi pribadi Chrome.

Jika laporan Anda berstatus "Tertunda", Anda dapat memilih laporan dan mengklik "Kirim Laporan yang Dipilih".

Mengirim laporan agregasi pribadi.

Mengirim laporan agregasi pribadi.

2.2. Membuat laporan agregat debug

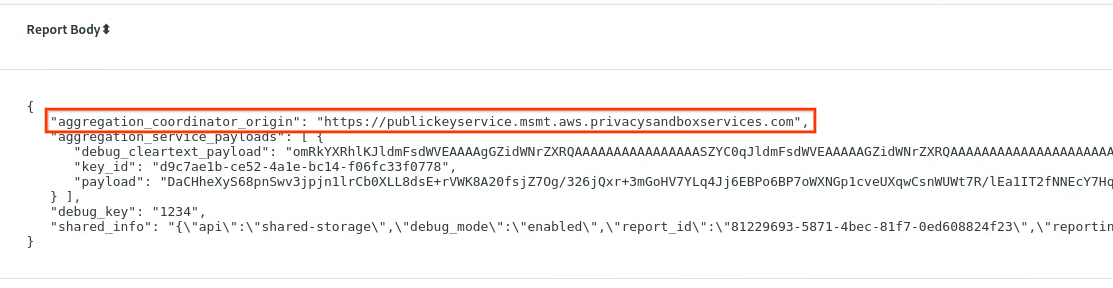

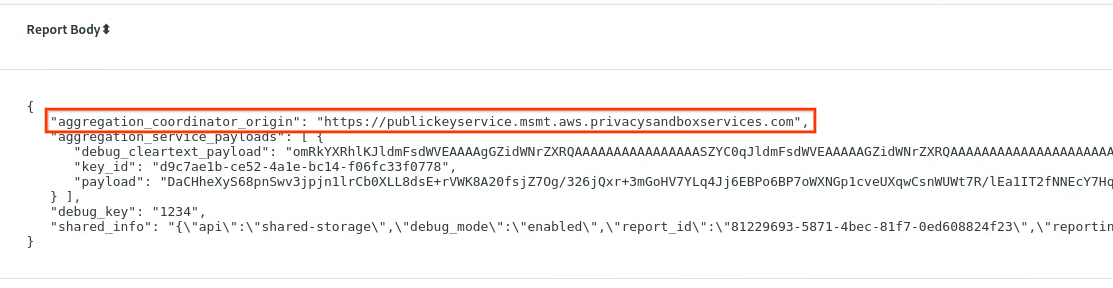

Di chrome://private-aggregation-internals, salin "Isi Laporan" yang diterima di endpoint [reporting-origin]/.well-known/private-aggregation/report-shared-storage.

Pastikan bahwa di "Report Body", aggregation_coordinator_origin berisi https://publickeyservice.msmt.aws.privacysandboxservices.com yang berarti laporan adalah laporan yang dapat diagregasi AWS.

Laporan agregasi pribadi.

Laporan agregasi pribadi.

Tempatkan "Isi Laporan" JSON dalam file JSON. Dalam contoh ini, Anda dapat menggunakan vim. Namun, Anda dapat menggunakan editor teks apa pun yang Anda inginkan.

vim report.json

Tempelkan laporan ke report.json dan simpan file Anda.

File JSON laporan.

File JSON laporan.

Setelah Anda memilikinya, buka folder laporan dan gunakan aggregatable_report_converter.jar untuk membantu membuat laporan agregat debug. Tindakan ini akan membuat laporan yang dapat diagregasi bernama report.avro di direktori saat ini.

java -jar aggregatable_report_converter.jar \

--request_type convertToAvro \

--input_file report.json \

--debug

2.3. Mengurai kunci bucket dari laporan debug

Layanan Agregasi memerlukan dua file saat membuat batch. Laporan yang dapat diagregasi dan file domain output. File domain output berisi kunci yang ingin Anda ambil dari laporan yang dapat diagregasi. Untuk membuat file output_domain.avro, Anda memerlukan kunci bucket yang dapat diambil dari laporan.

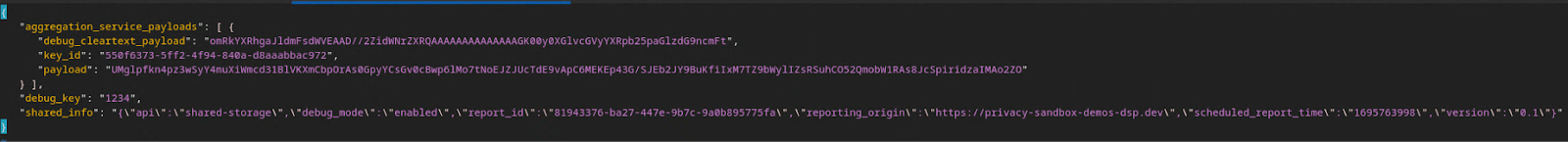

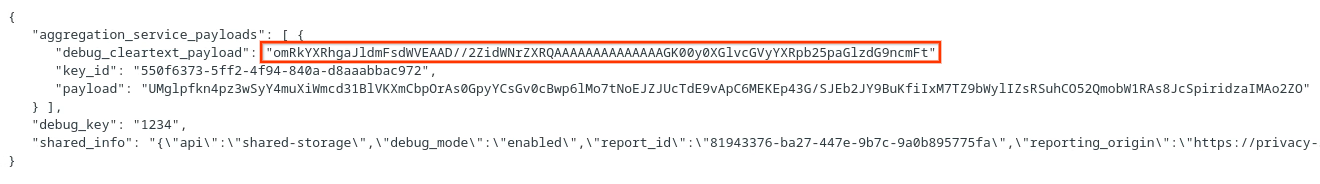

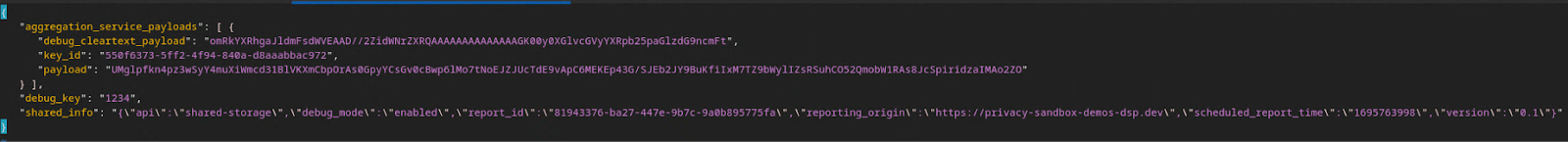

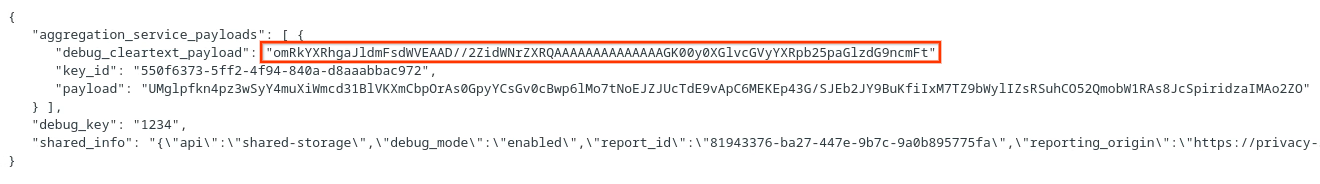

Kunci bucket dirancang oleh pemanggil API, dan demo berisi contoh kunci bucket yang telah dibuat sebelumnya. Karena demo telah mengaktifkan mode debug untuk Agregasi Pribadi, Anda dapat mengurai payload teks biasa debug dari "Isi Laporan" untuk mengambil kunci bucket. Namun, dalam kasus ini, demo sandbox privasi situs membuat kunci bucket. Karena penggabungan pribadi untuk situs ini dalam mode debug, Anda dapat menggunakan debug_cleartext_payload dari "Isi Laporan" untuk mendapatkan kunci bucket.

Salin debug_cleartext_payload dari isi laporan.

Debug payload teks biasa dari isi laporan.

Debug payload teks biasa dari isi laporan.

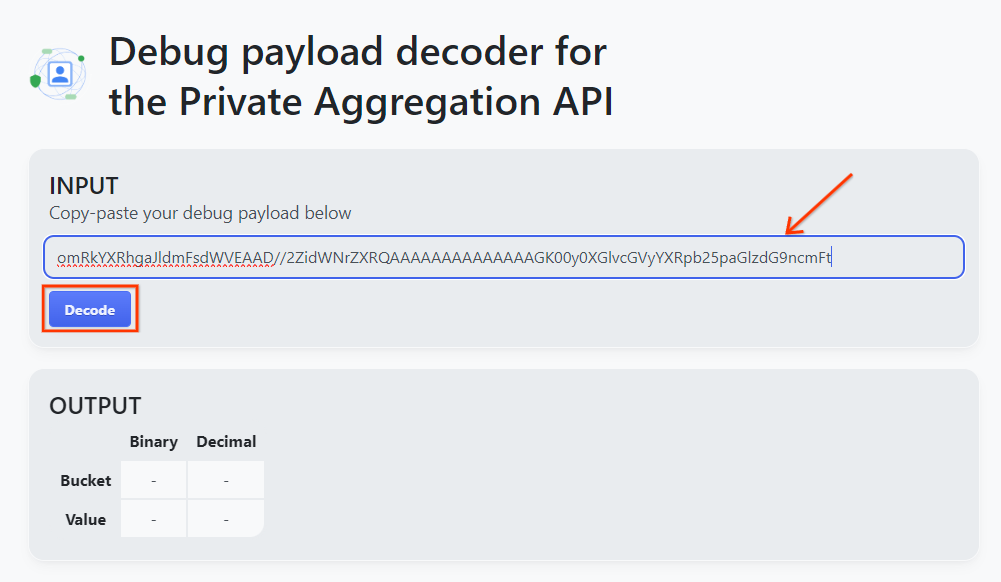

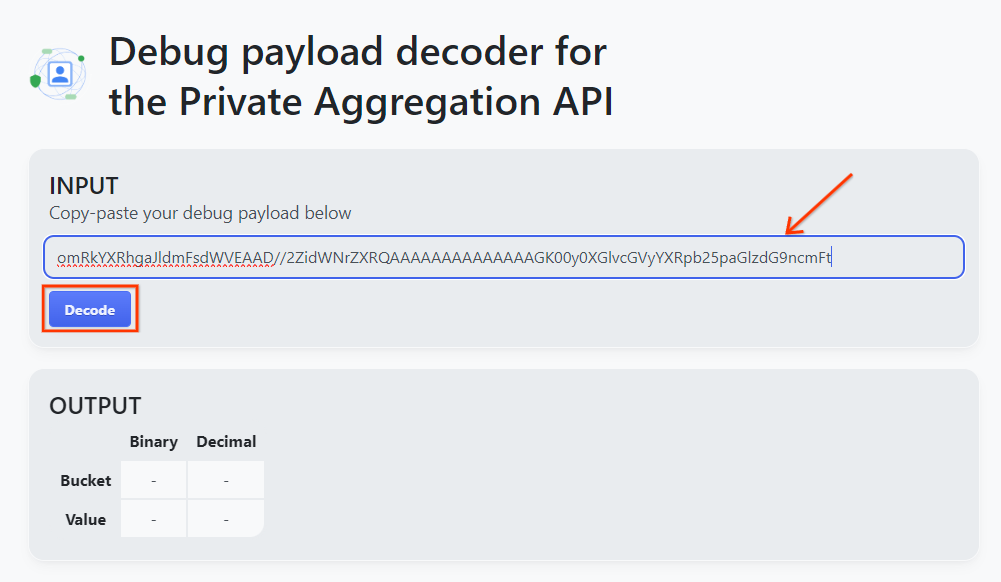

Buka alat Debug payload decoder for Private Aggregation, lalu tempelkan debug_cleartext_payload Anda di kotak "INPUT" dan klik "Decode".

Decoder payload.

Decoder payload.

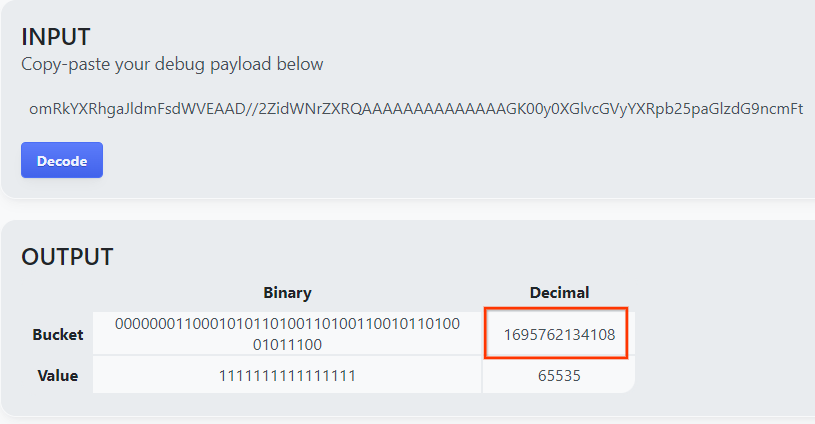

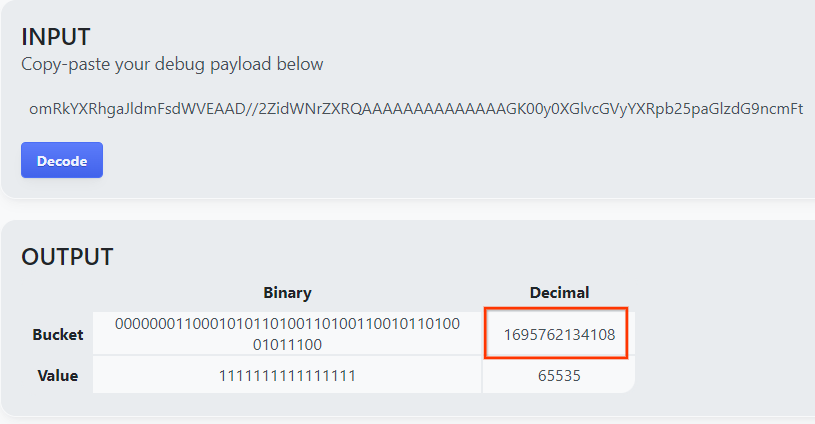

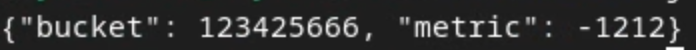

Halaman ini menampilkan nilai desimal dari kunci bucket. Berikut adalah contoh kunci bucket.

Hasil decoder payload.

Hasil decoder payload.

2.4. Buat AVRO domain output

Setelah mendapatkan kunci bucket, salin nilai desimal kunci bucket. Lanjutkan untuk membuat output_domain.avro menggunakan kunci bucket. Pastikan Anda mengganti

java -jar aggregatable_report_converter.jar \

--request_type createDomainAvro \

--bucket_key <bucket key>

Skrip akan membuat file output_domain.avro di folder saat ini.

2.5. Membuat laporan ringkasan menggunakan Alat Pengujian Lokal

Kita akan menggunakan LocalTestingTool_{version}.jar yang didownload di Bagian 1.1 untuk membuat laporan ringkasan. Gunakan perintah berikut. Anda harus mengganti LocalTestingTool_{version}.jar dengan versi yang didownload untuk LocalTestingTool.

Jalankan perintah berikut untuk membuat laporan ringkasan di lingkungan pengembangan lokal Anda:

java -jar LocalTestingTool_{version}.jar \

--input_data_avro_file report.avro \

--domain_avro_file output_domain.avro \

--output_directory .

Anda akan melihat sesuatu yang mirip dengan gambar berikut setelah perintah dijalankan. Laporan output.avro dibuat setelah proses ini selesai.

File avro laporan ringkasan pengujian lokal.

File avro laporan ringkasan pengujian lokal.

2.6. Meninjau laporan ringkasan

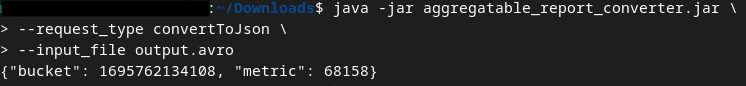

Laporan ringkasan yang dibuat dalam format AVRO. Untuk dapat membacanya, Anda perlu mengonversinya dari AVRO ke format JSON. Idealnya, teknologi iklan harus membuat kode untuk mengonversi laporan AVRO kembali ke JSON.

Untuk Codelab ini, kita akan menggunakan alat aggregatable_report_converter.jar yang disediakan untuk mengonversi laporan AVRO kembali ke JSON.

java -jar aggregatable_report_converter.jar \

--request_type convertToJson \

--input_file output.avro

Tindakan ini akan menampilkan laporan yang mirip dengan gambar berikut. Bersama dengan output.json laporan yang dibuat di direktori yang sama.

File avro ringkasan yang dikonversi ke json.

File avro ringkasan yang dikonversi ke json.

Buka file JSON di editor pilihan Anda untuk meninjau laporan ringkasan.

3. Deployment Layanan Agregasi

Untuk men-deploy Layanan Agregasi, gunakan langkah-langkah berikut:

Langkah 3. Deployment Layanan Agregasi: Deploy Layanan Agregasi di AWS

Langkah 3.1. Membuat Clone Repositori Layanan Agregasi

Langkah 3.2. Download dependensi bawaan

Langkah 3.3. Membuat lingkungan pengembangan

Langkah 3.4. Men-deploy Layanan Agregasi

3.1. Buat clone repositori Aggregation Service

Di lingkungan lokal Anda, clone repositori GitHub Layanan Agregasi.

git clone https://github.com/privacysandbox/aggregation-service.git

3.2. Mendownload dependensi bawaan

Setelah meng-clone repositori Aggregation Service, buka folder Terraform repositori dan folder cloud yang sesuai. Jika cloud_provider Anda adalah AWS, Anda dapat melanjutkan ke

cd <repository_root>/terraform/aws

Di download_prebuilt_dependencies.sh.

bash download_prebuilt_dependencies.sh

3.3. Membuat lingkungan pengembangan

Buat lingkungan pengembangan di dev.

mkdir dev

Salin konten folder demo ke folder dev.

cp -R demo/* dev

Pindahkan ke folder dev Anda.

cd dev

Perbarui file main.tf Anda dan tekan i untuk input guna mengedit file.

vim main.tf

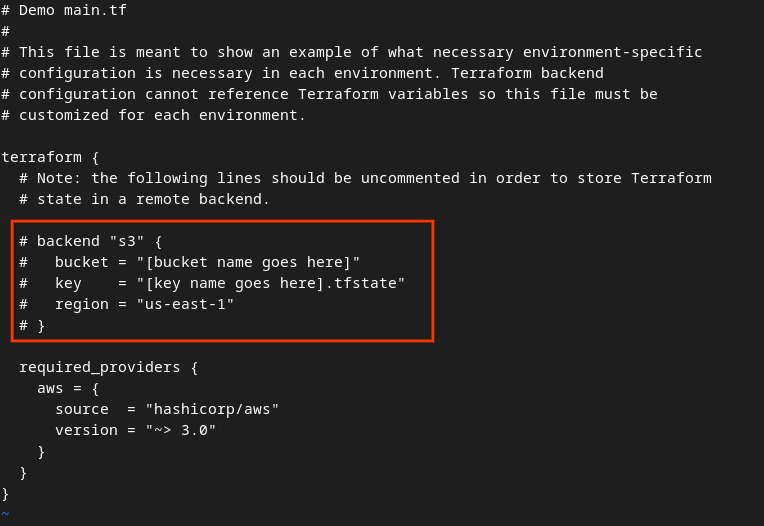

Hapus tanda komentar pada kode di kotak merah dengan menghapus # dan memperbarui nama bucket dan kunci.

Untuk main.tf AWS:

File tf utama AWS.

File tf utama AWS.

Kode tanpa komentar akan terlihat seperti berikut.

backend "s3" {

bucket = "<tf_state_bucket_name>"

key = "<environment_name>.tfstate"

region = "us-east-1"

}

Setelah pembaruan selesai, simpan pembaruan dan keluar dari editor dengan menekan esc -> :wq!. Tindakan ini akan menyimpan pembaruan di main.tf.

Selanjutnya, ganti nama example.auto.tfvars menjadi dev.auto.tfvars.

mv example.auto.tfvars dev.auto.tfvars

Perbarui dev.auto.tfvars dan tekan i untuk input guna mengedit file.

vim dev.auto.tfvars

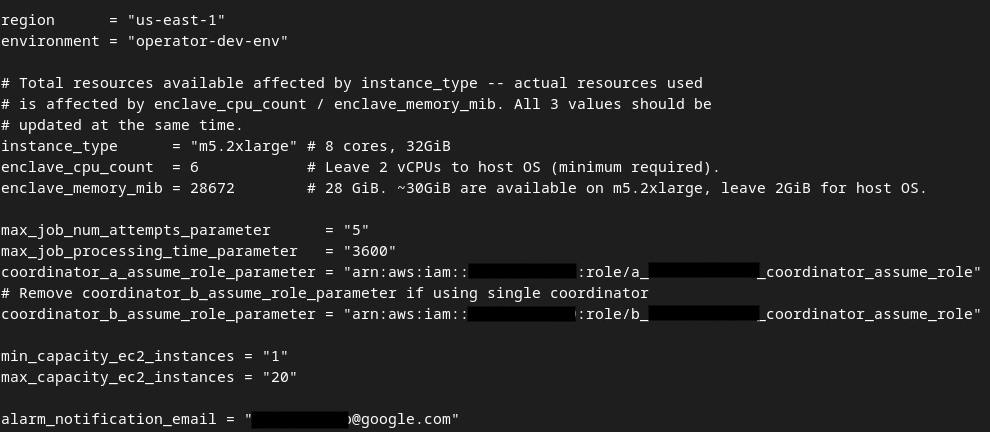

Perbarui kolom dalam gambar berikut yang berada dalam kotak merah dengan parameter ARN AWS yang benar yang diberikan selama aktivasi Layanan Agregasi, lingkungan, dan email notifikasi.

Edit file tfvars otomatis dev.

Edit file tfvars otomatis dev.

Setelah update selesai, tekan esc -> :wq!. Tindakan ini akan menyimpan file dev.auto.tfvars dan akan terlihat seperti gambar berikut.

Memperbarui file tfvars otomatis dev.

Memperbarui file tfvars otomatis dev.

3.4. Men-deploy Layanan Agregasi

Untuk men-deploy Aggregation Service, di folder

terraform init

Hasilnya akan terlihat seperti gambar berikut:

Terraform init.

Terraform init.

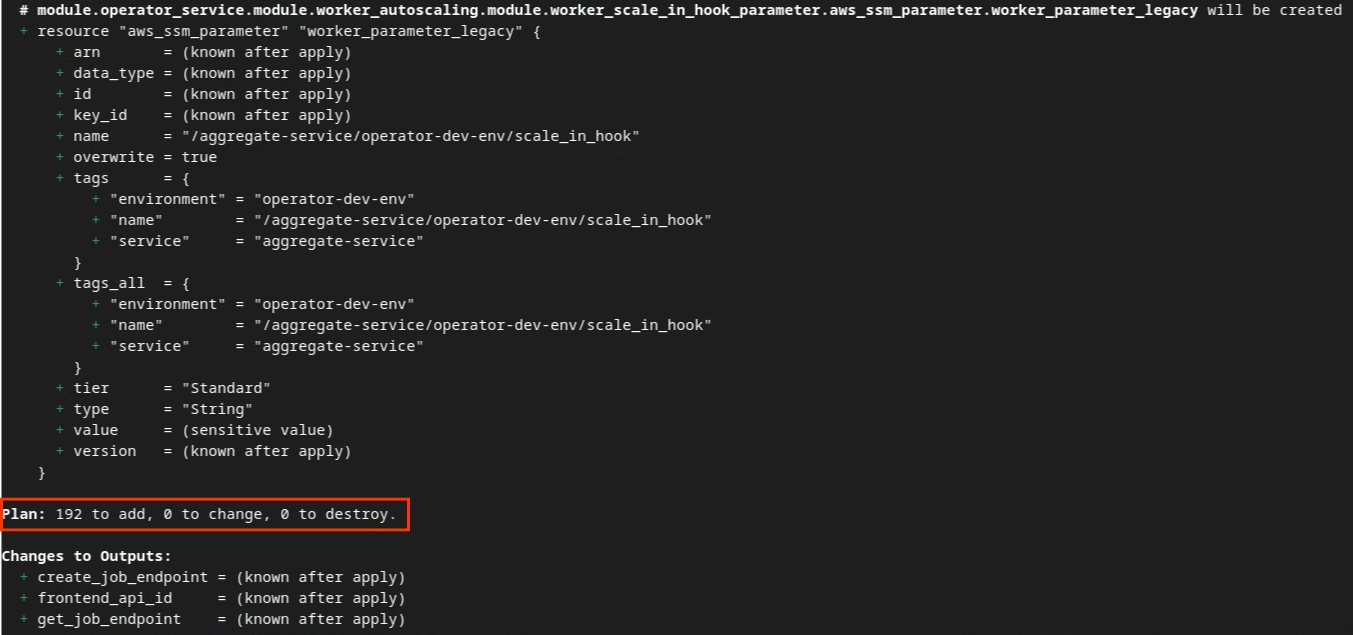

Setelah Terraform diinisialisasi, buat rencana eksekusi Terraform. Di mana perintah ini menampilkan jumlah resource yang akan ditambahkan dan informasi tambahan lainnya yang mirip dengan gambar berikut.

terraform plan

Anda dapat melihat ringkasan "Paket" berikut. Jika ini adalah deployment baru, Anda akan melihat jumlah resource yang akan ditambahkan dengan 0 untuk diubah dan 0 untuk dihapus.

Rencana Terraform.

Rencana Terraform.

Setelah selesai, Anda dapat melanjutkan untuk menerapkan Terraform.

terraform apply

Setelah diminta untuk mengonfirmasi tindakan oleh Terraform, masukkan yes ke dalam nilai.

Perintah penerapan Terraform.

Perintah penerapan Terraform.

Setelah terraform apply selesai, endpoint berikut untuk createJob dan getJob akan ditampilkan. frontend_api_id yang perlu Anda perbarui di Postman di bagian 1.9 juga ditampilkan.

Terraform apply complete.

Terraform apply complete.

4. Pembuatan input Layanan Agregasi

Lanjutkan untuk membuat laporan AVRO untuk pengelompokan dalam Layanan Agregasi.

Langkah 4. Pembuatan Input Layanan Agregasi: Buat laporan Layanan Agregasi yang dikelompokkan untuk Layanan Agregasi.

Langkah 4.1. Laporan Pemicu

Langkah 4.2. Kumpulkan laporan gabungan

Langkah 4.3. Mengonversi laporan ke AVRO

Langkah 4.4. Buat AVRO domain output

4.1. Laporan pemicu

Buka situs demo Privacy Sandbox. Tindakan ini akan memicu laporan agregasi pribadi. Anda dapat melihat laporan di chrome://private-aggregation-internals.

Internal agregasi pribadi Chrome.

Internal agregasi pribadi Chrome.

Jika laporan Anda berstatus "Tertunda", Anda dapat memilih laporan dan mengklik "Kirim Laporan yang Dipilih". '

Mengirim laporan agregasi pribadi.

Mengirim laporan agregasi pribadi.

4.2. Mengumpulkan laporan agregat

Kumpulkan laporan yang dapat diagregasi dari endpoint .well-known API yang sesuai.

- Agregasi Pribadi

[reporting-origin] /.well-known/private-aggregation/report-shared-storage - Attribution Reporting - Laporan Ringkasan

[reporting-origin] /.well-known/attribution-reporting/report-aggregate-attribution

Untuk Codelab ini, Anda akan melakukan pengumpulan laporan secara manual. Dalam produksi, teknologi iklan diharapkan mengumpulkan dan mengonversi laporan secara terprogram.

Di chrome://private-aggregation-internals, salin "Isi Laporan" yang diterima di endpoint [reporting-origin]/.well-known/private-aggregation/report-shared-storage.

Pastikan bahwa di "Report Body", aggregation_coordinator_origin berisi https://publickeyservice.msmt.aws.privacysandboxservices.com yang berarti laporan adalah laporan yang dapat diagregasi AWS.

Laporan agregasi pribadi.

Laporan agregasi pribadi.

Tempatkan "Isi Laporan" JSON dalam file JSON. Dalam contoh ini, Anda dapat menggunakan vim. Namun, Anda dapat menggunakan editor teks apa pun yang Anda inginkan.

vim report.json

Tempelkan laporan ke report.json dan simpan file Anda.

File JSON laporan.

File JSON laporan.

4.3. Mengonversi laporan ke AVRO

Laporan yang diterima dari endpoint .well-known berformat JSON dan perlu dikonversi ke format laporan AVRO. Setelah Anda memiliki laporan JSON, buka folder laporan Anda dan gunakan aggregatable_report_converter.jar untuk membantu membuat laporan debug yang dapat diagregasi. Tindakan ini akan membuat laporan yang dapat diagregasi bernama report.avro di direktori saat ini.

java -jar aggregatable_report_converter.jar \

--request_type convertToAvro \

--input_file report.json

4.4. Buat AVRO domain output

Untuk membuat file output_domain.avro, Anda memerlukan kunci bucket yang dapat diambil dari laporan.

Kunci bucket dirancang oleh teknologi iklan. Namun, dalam hal ini, situs demo Privacy Sandbox membuat kunci bucket. Karena penggabungan pribadi untuk situs ini dalam mode debug, Anda dapat menggunakan debug_cleartext_payload dari "Isi Laporan" untuk mendapatkan kunci bucket.

Lanjutkan dengan menyalin debug_cleartext_payload dari isi laporan.

Debug payload teks biasa dari isi laporan.

Debug payload teks biasa dari isi laporan.

Buka goo.gle/ags-payload-decoder dan tempel debug_cleartext_payload Anda di kotak "INPUT", lalu klik "Decode".

Decoder payload.

Decoder payload.

Halaman ini menampilkan nilai desimal dari kunci bucket. Berikut adalah contoh kunci bucket.

Hasil decoder payload.

Hasil decoder payload.

Setelah memiliki kunci bucket, lanjutkan dan buat output_domain.avro. Pastikan Anda mengganti

java -jar aggregatable_report_converter.jar \

--request_type createDomainAvro \

--bucket_key <bucket key>

Skrip akan membuat file output_domain.avro di folder saat ini.

4.5. Memindahkan laporan ke bucket AWS

Setelah laporan AVRO (dari bagian 3.2.3) dan domain output (dari bagian 3.2.4) dibuat, lanjutkan dengan memindahkan laporan dan domain output ke bucket S3 pelaporan.

Jika Anda telah menyiapkan AWS CLI di lingkungan lokal, gunakan perintah berikut untuk menyalin laporan ke bucket S3 dan folder laporan yang sesuai.

aws s3 cp report.avro s3://<report_bucket_name>/<report_folder>/

aws s3 cp output_domain.avro s3://<report_bucket_name>/<output_domain_folder>/

5. Penggunaan Layanan Agregasi

Dari terraform apply, Anda akan mendapatkan create_job_endpoint, get_job_endpoint, dan frontend_api_id. Salin frontend_api_id dan tempatkan ini ke dalam variabel global postman frontend_api_id yang Anda siapkan di bagian prasyarat 1.9.

Langkah 5. Penggunaan Layanan Agregasi: Gunakan Aggregation Service API untuk membuat laporan ringkasan dan meninjau laporan ringkasan.

Langkah 5.1. Menggunakan Endpoint createJob untuk batch

Langkah 5.2. Menggunakan Endpoint getJob untuk mengambil status batch

Langkah 5.3. Meninjau Laporan Ringkasan

5.1. Menggunakan endpoint createJob untuk batch

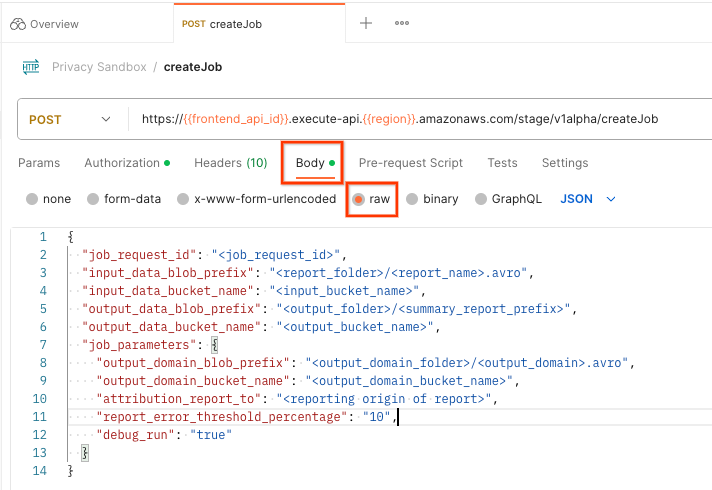

Di Postman, buka koleksi "Privacy Sandbox" dan pilih "createJob".

Pilih "Body" dan pilih "raw" untuk menempatkan payload permintaan Anda.

Isi permintaan postman createJob

Isi permintaan postman createJob

Skema payload createJob tersedia di github dan terlihat mirip dengan berikut ini. Ganti <> dengan kolom yang sesuai.

{

"job_request_id": "<job_request_id>",

"input_data_blob_prefix": "<report_folder>/<report_name>.avro",

"input_data_blob_prefixes": [

"<report_folder>/<report_name-1>/",

"<report_folder>/<report_name-2>/",

"<report_folder>/<report_name>.avro"

], // Mutually exclusive to input_data_blob_prefix as of v2.11.0

"input_data_bucket_name": "<bucket_name>",

"output_data_blob_prefix": "<output_folder>/<summary_report_prefix>",

"output_data_bucket_name": "<bucket_name>",

"job_parameters": {

"output_domain_blob_prefix": "<output_domain_folder>/<output_domain>.avro",

"output_domain_bucket_name": "<bucket_name>",

"attribution_report_to": "<reporting origin of report>",

"reporting_site": "<domain of reporting origin(s) of report>", // Mutually exclusive to attribution_report_to as of v2.7.0

"report_error_threshold_percentage": "10",

"debug_run": "true"

}

}

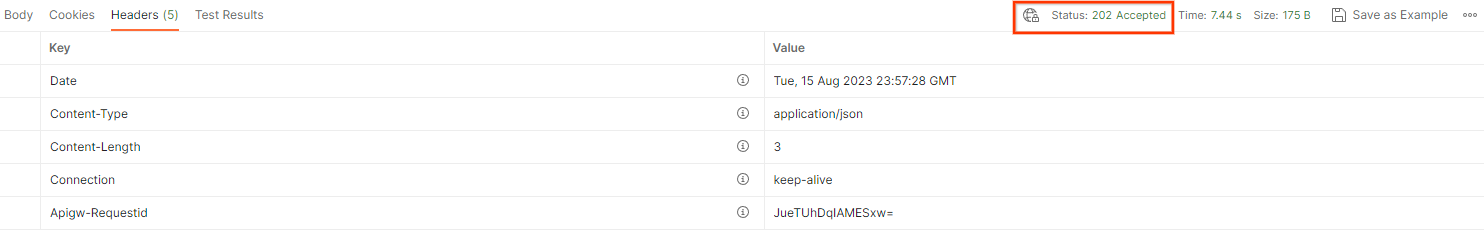

Setelah Anda mengklik "Kirim", pekerjaan dengan job_request_id akan dibuat. Anda akan menerima respons HTTP 202 setelah permintaan diterima oleh Layanan Agregasi. Kode hasil lainnya dapat ditemukan di Kode respons HTTP

status permintaan postman createJob

status permintaan postman createJob

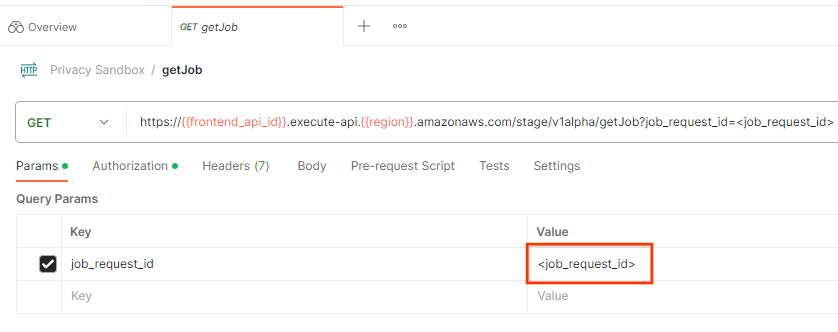

5.2. Menggunakan Endpoint getJob untuk mengambil status batch

Untuk memeriksa status permintaan tugas, Anda dapat menggunakan endpoint getJob. Pilih "getJob" di koleksi "Privacy Sandbox".

Di "Params", perbarui nilai job_request_id ke job_request_id yang dikirim dalam permintaan createJob.

permintaan getJob postman

permintaan getJob postman

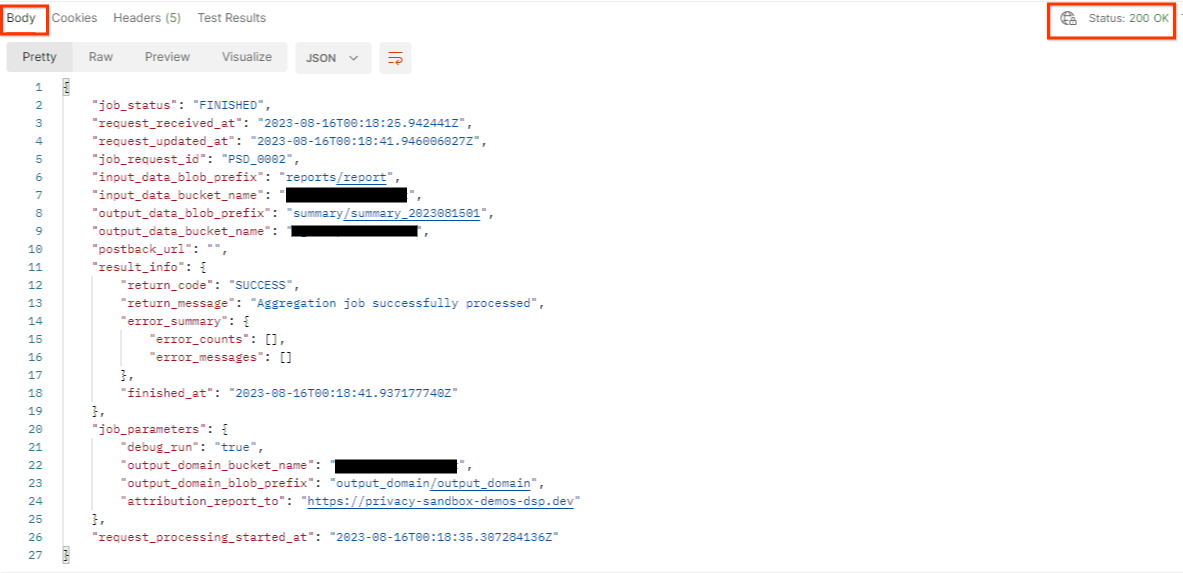

Hasil getJob akan menampilkan status permintaan tugas Anda dengan status HTTP 200. "Isi" permintaan berisi informasi yang diperlukan seperti job_status, return_message, dan error_messages (jika tugas mengalami error).

status permintaan getJob postman

status permintaan getJob postman

Karena situs pelaporan laporan demo yang dibuat berbeda dengan situs yang diaktifkan di ID AWS Anda, Anda mungkin menerima respons dengan return_code PRIVACY_BUDGET_AUTHORIZATION_ERROR. Hal ini normal karena situs asal pelaporan laporan tidak cocok dengan situs pelaporan yang diaktifkan untuk ID AWS.

{

"job_status": "FINISHED",

"request_received_at": "2023-12-07T22:50:58.830956Z",

"request_updated_at": "2023-12-07T22:51:10.526326456Z",

"job_request_id": "<job_request_id>",

"input_data_blob_prefix": "<report_folder>/<report_name>.avro",

"input_data_blob_prefixes": [ // Mutually exclusive to input_data_blob_prefix as of v2.11.0

"<report_folder>/<report_name-1>/",

"<report_folder>/<report_name-2>/",

"<report_folder>/<report_name>.avro"

],

"input_data_bucket_name": "<input_bucket_name>",

"output_data_blob_prefix": "<output_folder>/<summary_report_prefix>",

"output_data_bucket_name": "<output_bucket_name>",

"postback_url": "",

"result_info": {

"return_code": "PRIVACY_BUDGET_AUTHORIZATION_ERROR",

"return_message": "Aggregation job successfully processed",

"error_summary": {

"error_counts": [],

"error_messages": []

},

"finished_at": "2023-12-07T22:51:10.517730898Z"

},

"job_parameters": {

"debug_run": "true",

"output_domain_bucket_name": "<output_domain_bucket_name>",

"output_domain_blob_prefix": "<output_domain_folder>/<output_domain>.avro",

"attribution_report_to": "https://privacy-sandbox-demos-dsp.dev",

"reporting_site": "<domain of reporting origin(s) of report>", // Mutually exclusive to attribution_report_to as of v2.7.0

},

"request_processing_started_at": "2023-12-07T22:51:06.034472697Z"

}

5.3. Meninjau Laporan Ringkasan

Setelah menerima laporan ringkasan di Bucket S3 output, Anda dapat mendownloadnya ke lingkungan lokal. Laporan ringkasan dalam format AVRO dan dapat dikonversi kembali ke JSON. Anda dapat menggunakan aggregatable_report_converter.jar untuk membaca laporan menggunakan perintah berikut.

java -jar aggregatable_report_converter.jar \

--request_type convertToJson \

--input_file <summary_report_avro>

Tindakan ini akan menampilkan JSON nilai gabungan dari setiap kunci bucket yang terlihat mirip dengan gambar berikut.

Laporan ringkasan.

Laporan ringkasan.

Jika permintaan createJob Anda menyertakan debug_run sebagai true, Anda dapat menerima laporan ringkasan di folder debug yang ada di output_data_blob_prefix. Laporan dalam format AVRO dan dapat dikonversi menggunakan perintah sebelumnya ke JSON.

Laporan berisi kunci bucket, metrik tanpa derau, dan derau yang ditambahkan ke metrik tanpa derau untuk membentuk laporan ringkasan. Laporannya mirip dengan gambar berikut.

Laporan ringkasan debug.

Laporan ringkasan debug.

Anotasi juga berisi in_reports dan in_domain yang berarti:

- in_reports - kunci bucket tersedia di dalam laporan yang dapat diagregasi.

- in_domain - kunci bucket tersedia di dalam file AVRO output_domain.